Robots.txt файлы деген эмне? SEO үчүн робот файлын жазуу, тапшыруу жана кайра издөө үчүн керек болгон нерселердин баары

Биз жөнүндө кеңири макала жаздык издөө системалары сиздин веб-сайттарыңызды кантип табат, сойлошот жана индекстейт. Бул процесстин негизги кадамы болуп саналат robots.txt файл, сиздин сайтка издөө системасы үчүн шлюз. robots.txt файлын кантип туура курууну түшүнүү издөө системасын оптималдаштырууда маанилүү (SEO).

Бул жөнөкөй, бирок күчтүү курал веб-мастерлерге издөө системалары алардын веб-сайттары менен кантип иштешерин көзөмөлдөөгө жардам берет. Robots.txt файлын түшүнүү жана эффективдүү колдонуу веб-сайттын эффективдүү индексациясын жана издөө системасынын натыйжаларында оптималдуу көрүнүшүн камсыз кылуу үчүн абдан маанилүү.

Robots.txt файлы деген эмне?

Robots.txt файлы веб-сайттын түпкү каталогунда жайгашкан текст файлы. Анын негизги максаты - сайттын кайсы бөлүктөрү жөрмөлөп, индекстелиши керек же болбосо керектиги жөнүндө издөө системасынын жөрмөлөгүчтөрүн жетектөө. Файл Роботторду чыгарып салуу протоколун колдонот (REP), стандарттуу веб-сайттар веб жөрмөлөгүчтөрү жана башка веб-роботтор менен баарлашуу үчүн колдонушат.

REP расмий Интернет стандарты эмес, бирок кеңири кабыл алынган жана негизги издөө системалары тарабынан колдоого алынган. Кабыл алынган стандартка эң жакыны Google, Bing жана Yandex сыяктуу негизги издөө системаларынын документтери. Көбүрөөк маалымат алуу үчүн, зыярат Google'дун Robots.txt спецификациялары сунушталган.

Эмне үчүн Robots.txt SEO үчүн абдан маанилүү?

- Башкарылган сойлоо: Robots.txt веб-сайт ээлерине издөө системаларынын сайттын белгилүү бир бөлүмдөрүнө кирүүсүн алдын алууга мүмкүнчүлүк берет. Бул кайталанма мазмунду, купуя аймактарды же купуя маалыматы бар бөлүмдөрдү кошпогондо өзгөчө пайдалуу.

- Оптимизацияланган Crawl бюджети: Издөө системалары ар бир веб-сайт үчүн скандоо бюджетин бөлөт, издөө системасы бот сайтта сойлоп чыга турган барактардын саны. Тиешелүү эмес же анча маанилүү эмес бөлүмдөргө уруксат берүү менен, robots.txt бул скандоо бюджетин оптималдаштырууга жардам берип, маанилүүрөөк барактардын сойлоп жана индекстелишине кепилдик берет.

- Жакшыртылган веб-сайтты жүктөө убактысы: Боттордун маанилүү эмес ресурстарга кирүүсүнө жол бербөө менен, robots.txt сервердин жүгүн азайтып, сайттын жүктөө убактысын жакшыртат, бул SEOдеги маанилүү фактор.

- Жалпыга ачык эмес баракчалардын индексациясын алдын алуу: Бул жалпыга ачык эмес аймактарды (мисалы, сайттарды же өнүктүрүү аймактарын) индексациялоодон жана издөө натыйжаларында көрүнүүдөн сактоого жардам берет.

Robots.txt Негизги буйруктары жана аларды колдонуу

- Уруксат берүү: Бул директива сайттын кайсы барактарына же бөлүмдөрүнө жөрмөлөгүчтөр кирүүгө тийиш экенин көрсөтүү үчүн колдонулат. Мисалы, эгер веб-сайтта SEO үчүн өзгөчө тиешелүү бөлүм болсо, "Уруксат берүү" буйругу анын сойлоп кетишин камсыздай алат.

Allow: /public/- Уруксат берүү: "Уруксат берүү" дегенге карама-каршы, бул буйрук издөө системасынын ботторуна веб-сайттын айрым бөлүктөрүн сүзбөөгө көрсөтмө берет. Бул кирүү баракчалары же скрипт файлдары сыяктуу SEO мааниси жок барактар үчүн пайдалуу.

Disallow: /private/- Wildcards: Wildcards үлгү дал келүү үчүн колдонулат. Жылдызча (*) символдордун каалаган ырааттуулугун билдирет, ал эми доллар белгиси ($) URL дарегинин аягын билдирет. Бул URL даректеринин кеңири спектрин көрсөтүү үчүн пайдалуу.

Disallow: /*.pdf$- Сайттын карталары: Robots.txt сайтында сайттын картасынын жайгашкан жерин кошуу издөө системаларына сайттагы бардык маанилүү барактарды таап, сойлоп чыгууга жардам берет. Бул SEO үчүн өтө маанилүү, анткени ал сайтты тезирээк жана толук индексациялоого жардам берет.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt Кошумча буйруктар жана аларды колдонуу

- Колдонуучу-агент: Эреже кайсы жөрмөлөгүчкө колдонуларын көрсөтүңүз. 'Колдонуучу-агент: *' эрежени бардык жөрмөлөгүчтөр үчүн колдонот. Мисал:

User-agent: Googlebot- Noindex: Стандарттуу robots.txt протоколунун бир бөлүгү болбосо да, кээ бир издөө системалары а Noindex robots.txt дарегиндеги директиваны көрсөтүлгөн URL'ди индекстөөгө болбойт.

Noindex: /non-public-page/- Крол-кечиктирүү: Бул буйрук жөрмөлөгүчтөрдөн сервериңизге кирүүлөрдүн ортосунда белгилүү бир убакытты күтүүнү суранат, бул сервер жүктөө маселеси бар сайттар үчүн пайдалуу.

Crawl-delay: 10Robots.txt файлыңызды кантип сынаса болот

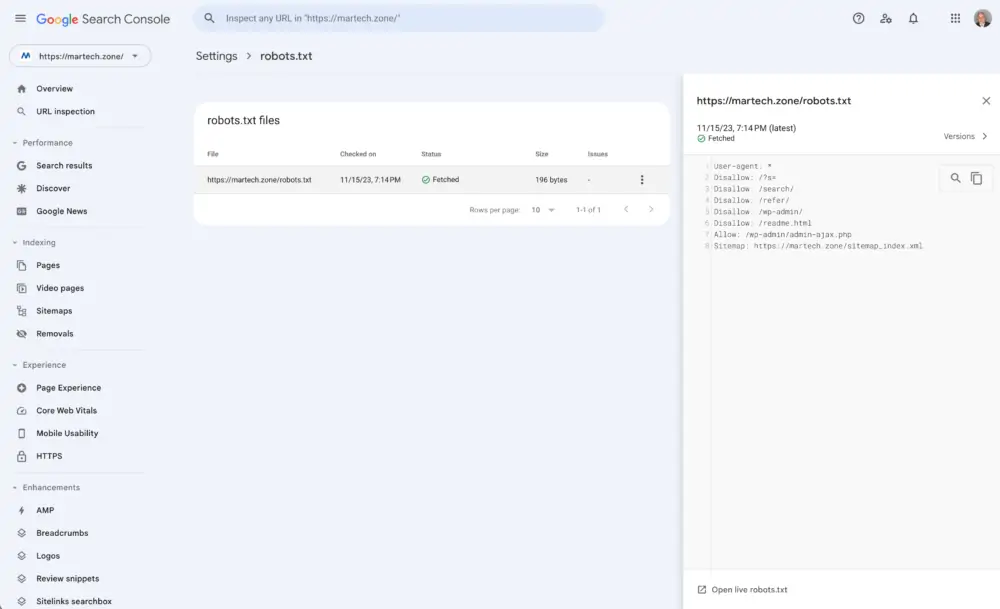

Ал көмүлгөн болсо да Google Search консолу, издөө консолу robots.txt файлын текшергичти сунуштайт.

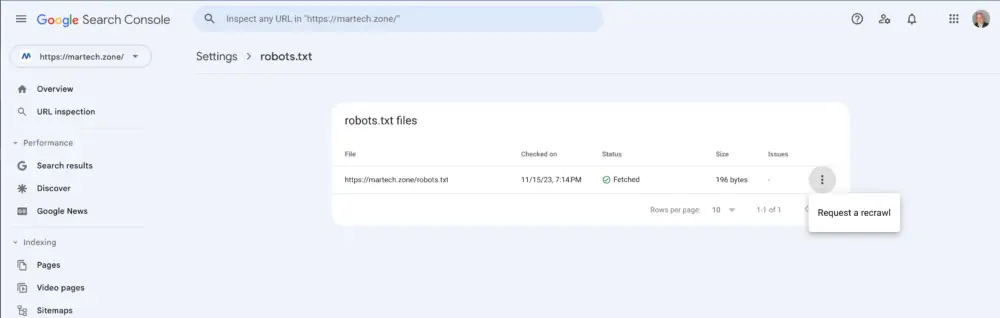

Сиз ошондой эле Robots.txt файлыңызды оң жактагы үч чекитти басып, тандоо менен кайра тапшырсаңыз болот. Кайра текшерүүнү сураныңыз.

Robots.txt файлыңызды сынап көрүңүз же кайра тапшырыңыз

Robots.txt файлын AI ботторун башкаруу үчүн колдонсо болобу?

robots.txt файлын аныктоо үчүн колдонсо болот AI боттор, анын ичинде веб жөрмөлөгүчтөрү жана башка автоматташтырылган боттор, сайтыңыздагы мазмунду сойлоп же колдоно алышат. Файл бул ботторду жетектейт, алар веб-сайттын кайсы бөлүктөрүнө кирүүгө уруксат берилген же тыюу салынганын көрсөтөт. AI боттордун жүрүм-турумун көзөмөлдөөчү robots.txt натыйжалуулугу бир нече факторлордон көз каранды:

- Протоколду сактоо: Көпчүлүк абройлуу издөө системалары жөрмөлөгүчтөрү жана башка көптөгөн AI боттору коюлган эрежелерди сыйлашат

robots.txt. Бирок, файл аткарыла турган чектөөгө караганда суроо-талап экенин белгилей кетүү маанилүү. Боттор бул суроо-талаптарды, өзгөчө анча кылдат эмес уюмдар башкарган өтүнүчтөрдү этибарга албай коюшу мүмкүн. - Көрсөтмөлөрдүн өзгөчөлүгү: Сиз ар кандай боттор үчүн ар кандай көрсөтмөлөрдү белгилей аласыз. Мисалы, сиз башкаларга тыюу салып, белгилүү бир AI ботторуна сиздин сайтыңызды кыдырууга уруксат беришиңиз мүмкүн. Бул колдонуу менен жүзөгө ашырылат

User-agentдирективасындаrobots.txtжогорудагы файлдын мисалы. Мисалы,User-agent: GooglebotGoogle'дун жөрмөлөгүчүнө нускамаларды аныктайт, ал эмиUser-agent: *бардык боттор үчүн колдонулат. - чектөөлөр: жатканда

robots.txtботтордун көрсөтүлгөн мазмунду сүзүп өтүшүнө жол бербейт; Бул алардан мазмунду жашырбайт, эгерде алар мурунтан эле билсе URL. Кошумча, ал сойлоп чыккандан кийин мазмундун колдонулушун чектөө үчүн эч кандай каражат бербейт. Эгер мазмунду коргоо же колдонуунун белгилүү бир чектөөлөрү талап кылынса, сырсөз менен коргоо сыяктуу башка ыкмалар же жетүүнү башкаруунун татаалыраак механизмдери талап кылынышы мүмкүн. - Боттордун түрлөрү: Бардык AI боттору издөө системалары менен байланыштуу эмес. Ар кандай боттор ар кандай максаттар үчүн колдонулат (мисалы, маалыматтарды топтоо, аналитика, мазмунду кыруу). Robots.txt файлы ошондой эле REPге карманып турса, бул ар кандай боттордун кирүү мүмкүнчүлүгүн башкаруу үчүн колдонулушу мүмкүн.

The robots.txt файл AI ботторунун сайттын мазмунун сойлоп чыгууга жана колдонууга байланыштуу каалоолоруңузду билдирүү үчүн эффективдүү курал боло алат. Бирок, анын мүмкүнчүлүктөрү кирүүгө катуу көзөмөл жүргүзүү эмес, көрсөтмөлөрдү берүү менен гана чектелет жана анын натыйжалуулугу боттордун Роботторду жокко чыгаруу протоколуна ылайыктуулугунан көз каранды.

robots.txt файлы SEO арсеналындагы кичинекей, бирок күчтүү курал. Ал туура колдонулганда веб-сайттын көрүнүүсүнө жана издөө системасынын иштешине олуттуу таасир этиши мүмкүн. Сайттын кайсы бөлүктөрү жөрмөлөп жана индекстелерин көзөмөлдөө менен, веб-мастерлер алардын эң баалуу мазмуну баса белгиленип, SEO аракеттерин жана веб-сайттын иштешин жакшыртат.